【Netskope】シャドーAIの可視化はどこまでできるの?【生成AIセキュリティ対策シリーズ】

ネクストモードの赤井です。

企業が生成AIを安全に活用するためのセキュリティ対策を解説するシリーズです。

Okta、Netskope、CrowdStrikeを活用した実践的なアプローチを紹介します。

1. 「AI」の可視化の重要性

生成AIの業務利用が急速に進む一方、情報システム部門が把握していない「シャドーAI」(従業員が個人で利用するAIサービス)が大きなセキュリティリスクとなっています。

- リスク例:

- 従業員が個人契約のChatGPTに、社外秘の企画書を要約させる。

- 機密情報が含まれたソースコードを、プログラミング支援AIに貼り付ける。

- AIサービス側が、入力された情報を学習データとして利用してしまう。

これらのリスクに対処する第一歩が、可視化です。

2. NetskopeでできるAI利用の「可視化」

Netskopeは、SASE/SSEソリューションの中核として、社内やリモートワーク環境からのあらゆるクラウド通信を監視します。これにより、シャドーAIの利用状況を詳細に可視化できます。

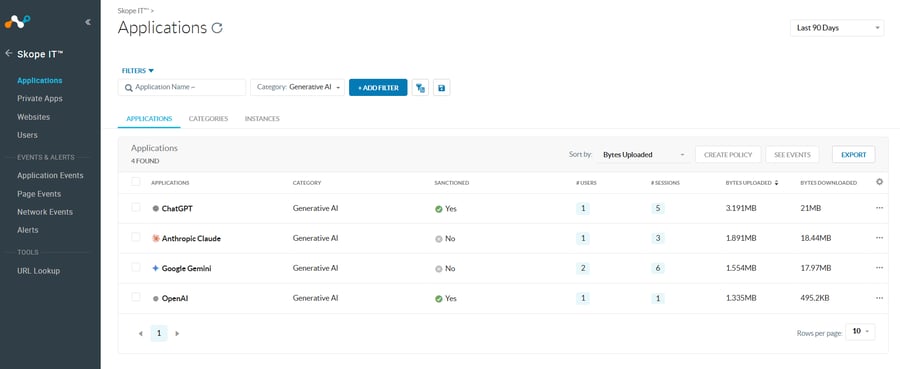

2-1:利用されている「シャドーAI」の網羅的な検知

SkopeIT > Applicationsから「社内でどのようなAIが使われているか」を特定します。

- 広範なAIアプリの識別:ChatGPT、Copilot、Geminiといった主要AIだけでなく、Netskopeが持つ数万のアプリケーションカタログに基づき、従業員が利用しているAIツールを検出します。

- SkopeIT:SkopeIT > ApplicationsどのAIが、何人に、どれくらいの頻度で使われているかを一覧で把握できます。

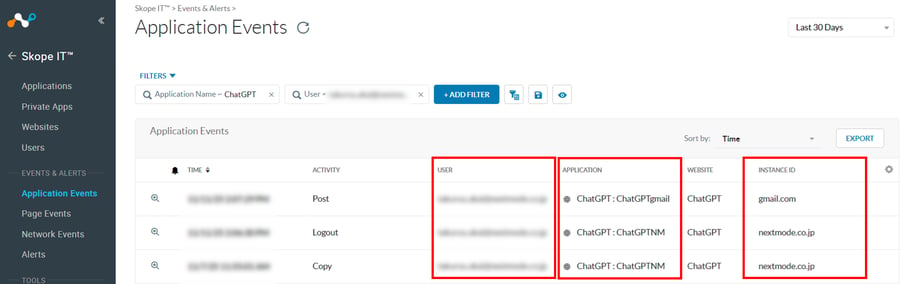

2-2:「誰が」「どのように」使っているかの詳細な把握

単なる利用有無だけでなく、「誰が、どのAIを、どう使ったか」をアクティビティ(操作)レベルで可視化します。

- インスタンスの識別:同じChatGPTでも、会社契約か個人の無料版かを区別して識別可能です。

- アクティビティの可視化:以下の操作をユーザー単位で把握できます。

ログイン/ログイン失敗ポスト(プロンプトの入力・送信)ファイルのアップロード/ダウンロードコピー/ペースト共有

下記画像は例ですが、SkopeIT > Application Eventsからユーザーごとに、利用インスタンスと実行アクティビティを具体的に把握できます。

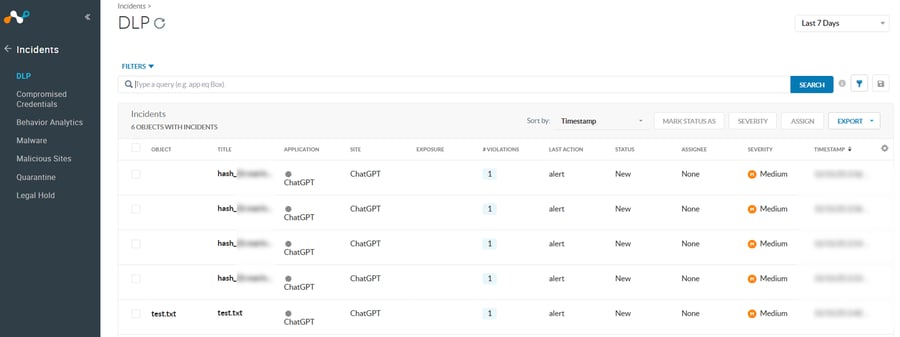

2-3:送信された「データの中身」と「リスク」の可視化

NetskopeはDLP機能を備えており、AIに送信されるデータの中身までチェックします。

- SSL/TLS通信の復号:暗号化された通信(HTTPS)の中身を検査し、プロンプトに入力されたテキストやファイルの内容を分析します。

- 機密情報の検知:あらかじめ定義されたルールに基づき、「社外秘」「個人情報」「マイナンバー」「ソースコード」などの機密情報がAIに送信された場合、それを検知・記録します。

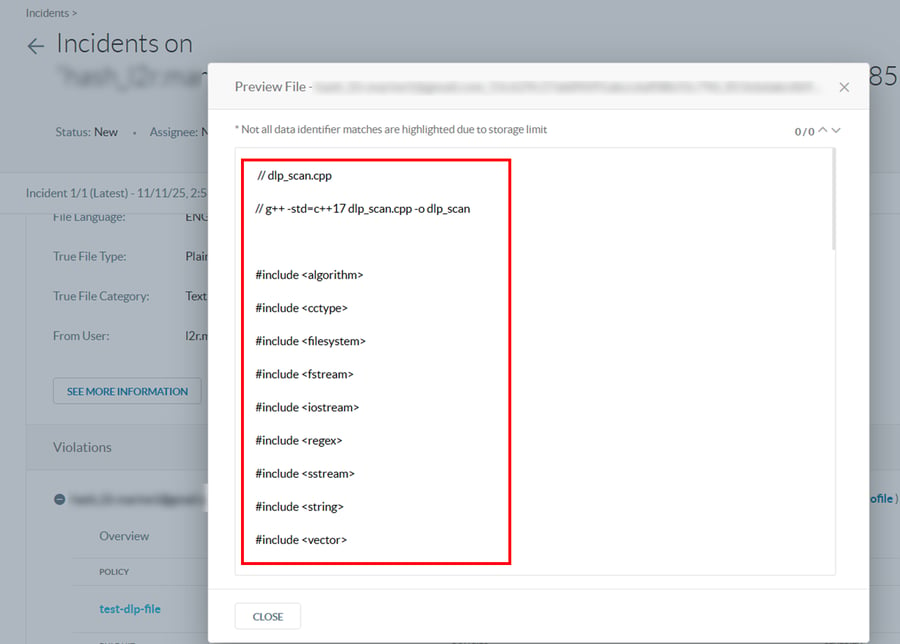

下記画像はファイルの添付やソースコードをPOSTした際の例ですが、Incidents > DLPからどのデータか、Forensicsの設定があればその中身まで確認できます。

2-4:そのAIアプリは「安全」か?リスク評価

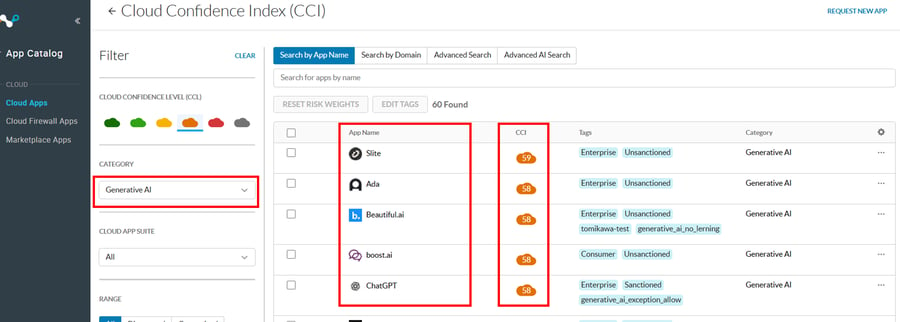

App Catalog > Cloud Appsから検知したAIアプリがそもそも安全なのかを、Netskope独自の評価指標(CCI: Cloud Confidence Index、クラウド信頼指数)で可視化します。

- 「データをAIの学習に利用するか?」

- 「データを第三者と共有するか?」

- 「GDPRなどの規制に対応しているか?」

これらの項目に基づき、AIアプリ自体のリスクスコアを自動で評価します。

3. 可視化から制御へ

Netskopeは、可視化したリスクにすぐ対処できる点も強みです。

- リアルタイム制御:「個人版AIへの機密情報のポスト(送信)」や「リスクの高いAIへのファイルアップロード」といった操作をリアルタイムでブロックできます。

- ユーザーへのコーチング(教育):従業員がリスクの高い操作をしようとした際に、「このAIの利用は禁止されています。代わりに会社契約のAIを利用してください」といった警告メッセージを画面に表示し、安全なAIへ誘導することが可能です。

4. まとめ

Netskopeを活用することで、シャドーAIの「利用状況」「操作内容」「送信データ」までを詳細に可視化し、情報漏洩のリスクを未然に防ぐ具体的な制御が可能になります。