【Netskope】ChatGPTなどの生成AIを可視化/制御する方法とは?【生成AIセキュリティ対策シリーズ】

はじめに

企業が生成AIを安全に活用するためのセキュリティ対策を解説するシリーズです

Okta、Netskope、CrowdStrikeを活用した実践的なアプローチを紹介します

こんにちは、セキュリティを気にする年頃の ネクストモード株式会社 のtommyです

ネクストモードでは社内システムとして利用しているSaaSやWebへのアクセスにおいて、Netskopeを経由する構成を取り、通信の可視化や制御を行っています。また、最近では生成AIを安全に活用するためのセキュリティ対策としても活躍しております

今回はそんな生成AIに対してOkta、Netskope、CrowdStrikeを活用した実践的なアプローチを紹介するシリーズの一環として、Netskopeでは生成AIの制御について、どんなアプローチがあるのかという概要を説明していきます

Netskopeとは

Netskopeとは、クラウドサービスの使用時に生じる情報漏洩のリスクや、外部の第三者による不正アクセス、マルウェアの感染といった脅威から機密情報を守り、SaaS環境のセキュリティを強化することができるSASEソリューションです

詳細は下記を御覧ください

生成AIを制御する必要性

生成AIを使うことで効率が上がったりする世の中において、なぜ便利な生成AIを制御する必要あるのでしょうか。ここで、CASBやDLPを導入する際に考慮することが多い、なぜSaaSを制御する必要があるのかを考えてみます

SaaSは様々な特徴を持って、世の中に無数に存在します。クラウドストレージや、コミュニケーションツール、CRMなどが例になります。そんな数多あるSaaSを会社が認知できていない、いわゆる「シャドーIT」が横行しているというのが現在です。これは、シャドーITは安全なもののみなのか、会社にバレずに情報漏洩できてしまうのではないかといった会社のセキュリティポリシーに準拠しているかがわからないということが問題になります。このシャドーITの利用SaaS名や、UploadやDownload、Shareなどどんな使われ方をしているかを可視化し、制御することを考えることが企業にとって早急に対処すべき課題と言えるでしょう。これがCASBです

また、プライベートでも会社でも同じ名前のSaaSを使う機会が増えてきました。Google Workspaceや、SNSなども会社のオフィシャルアカウント、個人のものなどが一例です。これも、個人で利用しているSaaSは制御対象にし、会社契約SaaSは使わせるといった制御。これがCASBのインスタンス制御です

また、取引先と利用しているSaaSについても考慮すべき点として、情報漏洩の心配があります。これは悪意の有無関係なく、個人情報等を取引先とのSaaSにUploadし、情報が本来渡すべき相手ではない会社/ユーザーに渡ってしまえば情報漏洩になってしまいます。これを防ぐのがDLPになります

シャドーITやSaaSの制御を考えるためにCASBやDLPを例に出しましたが、生成AIもその対象と言えるでしょう。会社が認知しておらず、部署で勝手に契約している生成AIは、はたして会社のセキュリティポリシーを準拠しているものでしょうか。個人契約している生成AIを使わせて問題ないでしょうか。悪意があれば、情報漏洩のリスクもあります。生成AIがプロンプトを学習データとして利用する場合、生成AIに与えるプロンプトの中に個人情報が入っていると情報漏洩の恐れがあるのではないでしょうか

従業員に生成AIを使ってもらうことで効率は確かにアップすると、私も思います。ただ、効率のためにセキュリティは捨てていいものでは無いのです。

Netskopeではそれが可能です。生成AIを使って業務を効率化し、その生成AIを会社のセキュリティに添わせる形で使わせることがNetskopeの強みと言えるでしょう。それでは、具体的によくある生成AI利用時のセキュリティお悩みをまとめてみました

生成AI利用時のお悩みごとを考えてみた

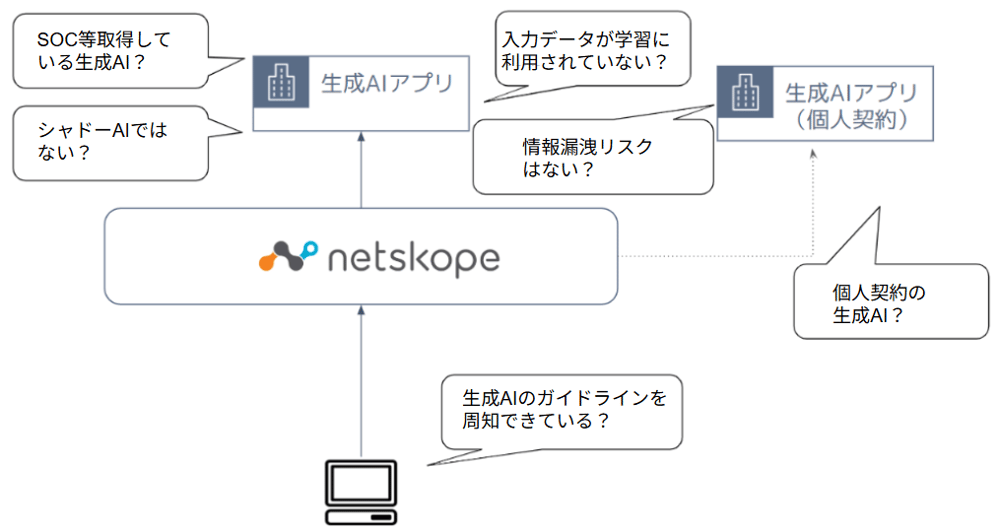

上の図では業務において、会社契約の生成AI、個人契約の生成AIを利用する際のよくあるお悩みを書いてみました。解説とNetskopeで行う対処の概要を書いていきます

〇会社契約の生成AI利用の場合

-

認証取っているアプリ?

- 例えば、ChatGPTはビジネス用においてSOC 2 Type 2を取得しています。Claudeは商用利用において、HIPAAやSOC 2 Type 1、Type2を取得しています。こういった、認証を取っている生成AIアプリなのかも確認ポイントの1つです

- Netskopeでは、App Catalog (旧CCI) という8万を超えるアプリのカタログがあります。ここには、どんな認証を取得しているのかの記載があるため、自社の生成AI利用を可視化した際に、その生成AIがどんな認証を取得しているのかをすぐに確認可能となっています。また、特定の認証を取得していない生成AIは制御するなども可能です

-

シャドーAIではない?

- 企業が利用を把握していない生成AIなのかも確認ポイントです。それが会社にとってリスクのあるものであれば、制御したいものです

-

- Netskopeでは生成AIの利用を検知し、利用状況を可視化します。可視化したうえで、そのSaaSを認可/非認可というタグ付けをし、非認可の生成AIに対して制御をすることが可能です

-

入力データが学習に利用されていない?

- 生成AIに個人情報を入力し、それを学習データして利用されてしまうと、その生成AIを利用している他社に生成AIのアウトプットとして個人情報が意図せず渡ってしまう可能性があります。ものによっては、有料プランは学習データとして利用しないが無料プランは利用するような生成AIも存在します

- Netskopeでは、上述のApp Catalog (旧CCI)に学習データとして利用するかという項目があり、はい/いいえとなっております。これについて、利用する場合は制御するなどを検討することが可能です

-

生成AIのガイドラインを周知できている?

- これは企業にもよりますが、生成AIを利用する際のポリシーなどがまとまったガイドラインを作成している企業も多いのではないでしょうか。ガイドラインがあっても、社員が読まずに順守していない場合はもったいないです。定期的に周知することが重要です

-

- Netskopeでは、User Alertという生成AIを利用しようとする際に、ポップアップが表示され、そこに表示されたボタンをクリックすることで問題なく生成AIを利用できる機能があります。そのポップアップに、ガイドラインへのURL等を載せておくことでガイドラインの形骸化を防ぎ従業員への周知などが実施可能です

〇個人契約の生成AI利用の場合

-

情報漏洩リスクはない?

- そもそも業務で個人契約の生成AI利用をするのかという疑問はありますが、利用する場合、情報漏洩リスクはないでしょうか。ないと言い切ることはかなり難しいと思いますので、企業としてはDLPを設定することで対策と言えるでしょう

- Netskopeでは、DLPの設定が可能です。"社外秘"であったり、"個人情報"といった単語を検知対象とすることはもちろん、Netskopeが事前定義している"日本人の名前"や"日本の法人名"、"マイナンバーカード"などを検知対象にすることができるため、もし入力データが学習に利用される生成AIでも、個人情報や社外に渡らせたくない情報を設定しておくことで漏洩リスクの低減が可能になります

-

個人契約の生成AI?

- これは、例えば"*@gmail.com"など、個人で利用しているドメインで契約している生成AIなのかという確認ポイントです。個人契約の生成AIの利用状況を把握することは、シャドーAI対策の一歩目になると言えるでしょう

- Netskopeでは、いくつかの生成AIに対して生成AIへのログインIDのドメインを検知し、そのドメインに応じた制御が可能です。企業ドメインは制御せず、*@gmail.comはブロックするなどの制御が可能です。また、インスタンス制御もできるので個人インスタンスでの制御なども可能です

今出てきた生成AI利用時のセキュリティのお悩みに思い当たるものがあれば、ぜひNetskopeをご検討してみてはいかがでしょうか

さいごに

いかがでしたでしょうか。生成AIのセキュリティを考える一助になると嬉しいと思い、書いてきました。Netskopeでできる生成AI制御を今後も書いていきますので、ぜひこのシリーズを読んでいただけると嬉しいです

ネクストモードでは、Netskopeをはじめ、OktaやCrowdStrikeを活用したSaaS・生成AIの包括的なセキュリティ対策をご支援しています 。ご興味のある方は、ぜひお気軽にご相談ください!